8-1 Component of Convolutional Neural Network

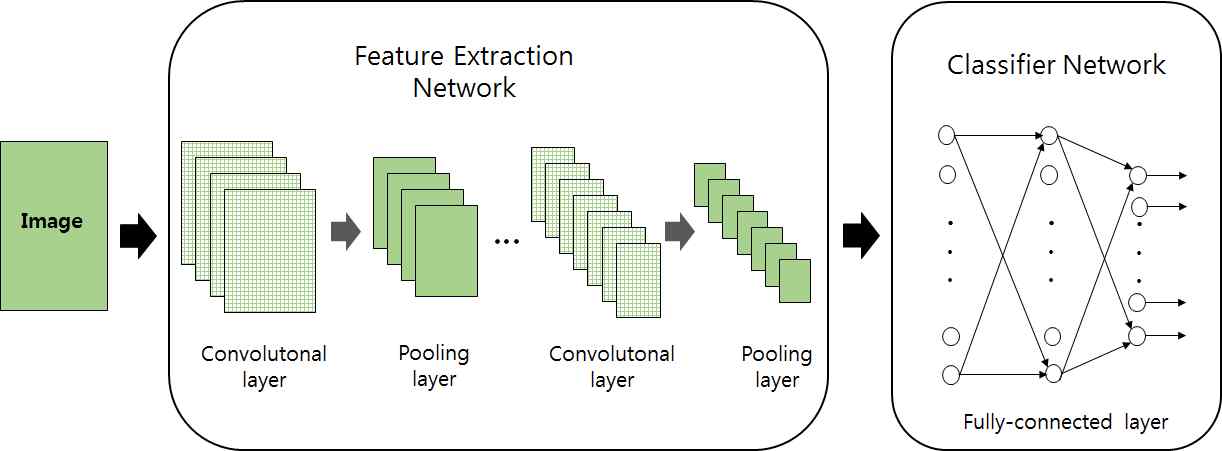

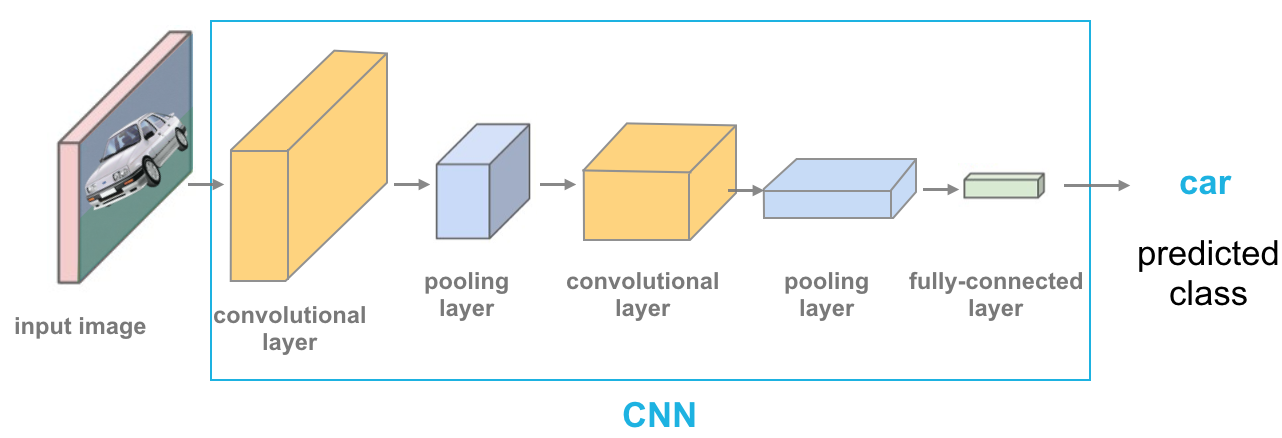

1. CNN Structure

- CNN(Convolutional Neural Network, 합성곱 신경망)은 일반적으로 다음과 같은 계층으로 구성된 Neural Network의 일종이다.

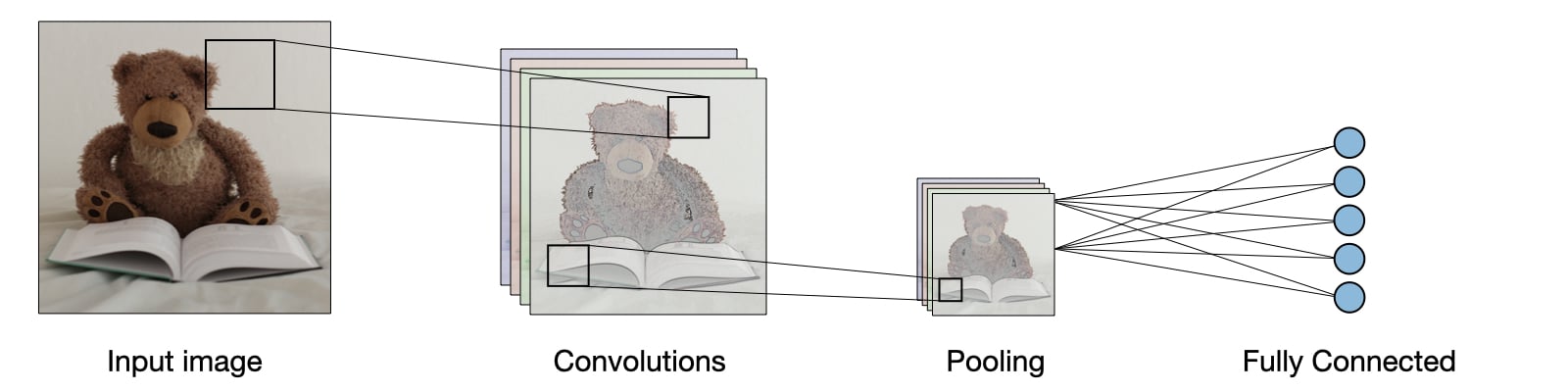

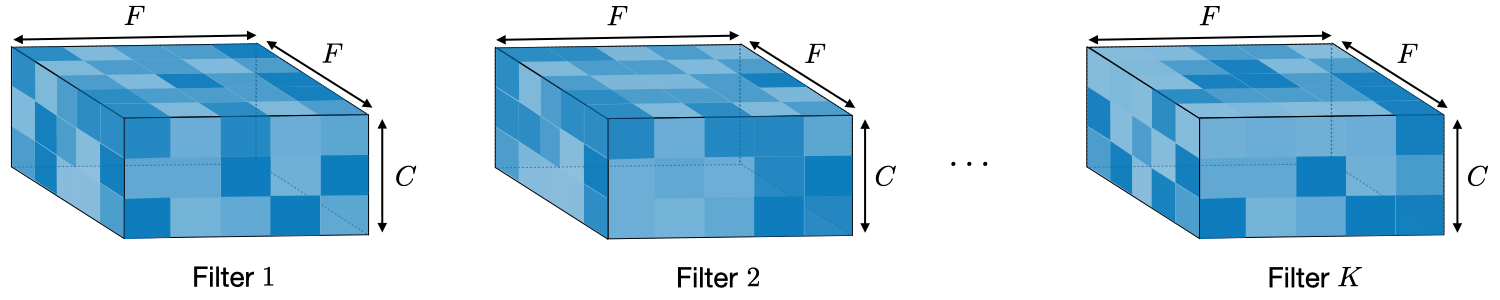

1-1. Convolutions

- Input Image의 Feature Extaction(특성 추출)

- Filter (Kernel) 사용

- 입력 값을 스캔하며 합성곱(Convolution) 연산을 수행

- Filter의 Hyperparameter는 크기 F와 스트라이드(Strides) S를 포함

- Filter 스캔 후 Activate Function을 통해 Feature Extraction

- Convolution Layer의 Output은 Feature Map 또는 Activate Map이라 한다.

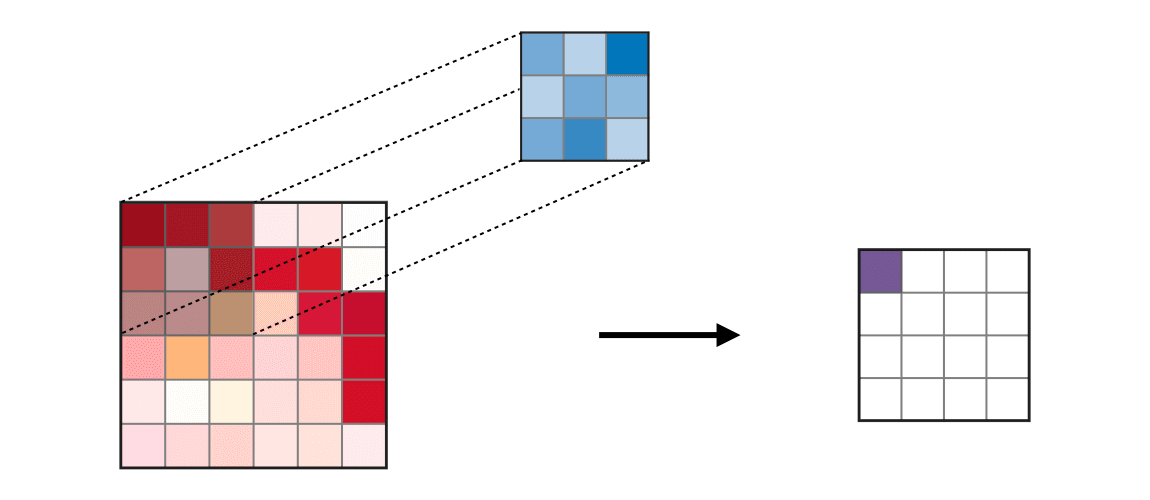

1-2. Pooling

- Convolution Layer에서 추출된 Feature Map의 Downsampling(차원을 축소하는) 작업

- Feature Map의 크기를 줄이며, 개수는 줄이지 않는다. (Feature Map의 개수 : Filter 개수)

- Filter와 같은 가중치가 없고, 대신에 최대값이나 평균값을 계산하는 역할을 수행

- 최대 풀링(Max Pooling)

- 평균 풀링(Average Pooling)

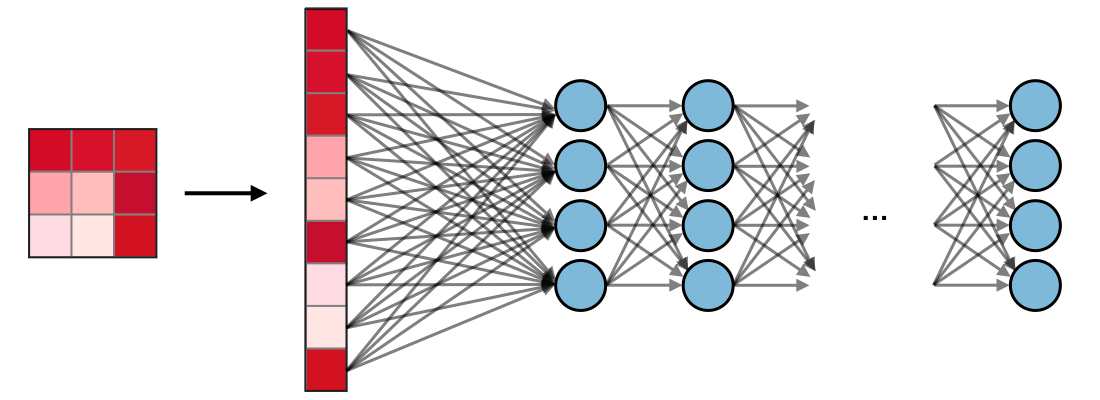

1-3. Fully Connected

- Pooling Layer에 의해 Downsampling된 Feature Map을 하나의 열 벡터로 변환하여 Input으로 사용

- FC Layer은 일반적으로 CNN 구조 끝 부분에서 발견되며, 클래스 점수와 같은 목표를 최적화

- 이때, Overfitting을 막기 위해 Drop-Out 기법 사용

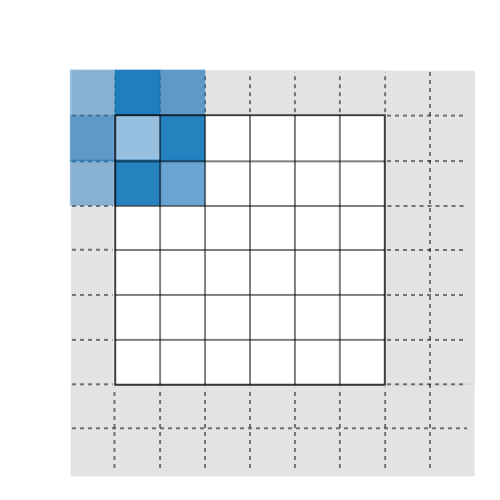

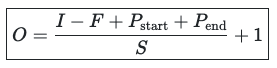

2. HyperParameter Tuning

- Convolutions 계층은 Filter의 Hyperparameter의 의미를 아는 것이 중요하다.

- Filter Size

- Stride : Window가 이동하는 픽셀 수

- Zero-Padding : Input Imaged의 각 경계면에 P개의 Zero를 더하는 과정

- Convolution Layer의 Parameter 호환성

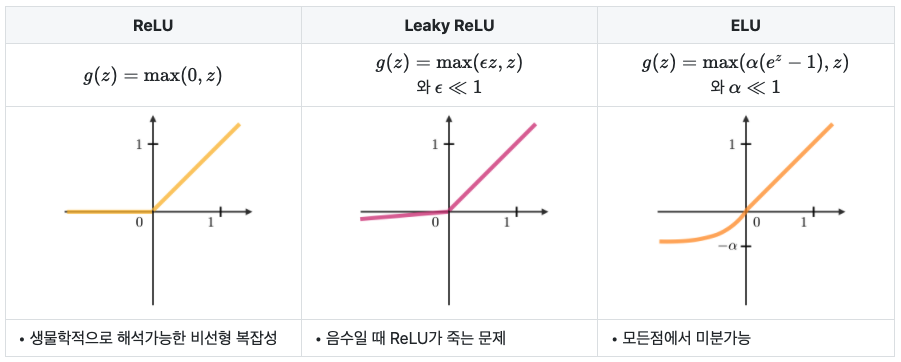

3. Activate Functions

- 주로 사용되는 Activate Function

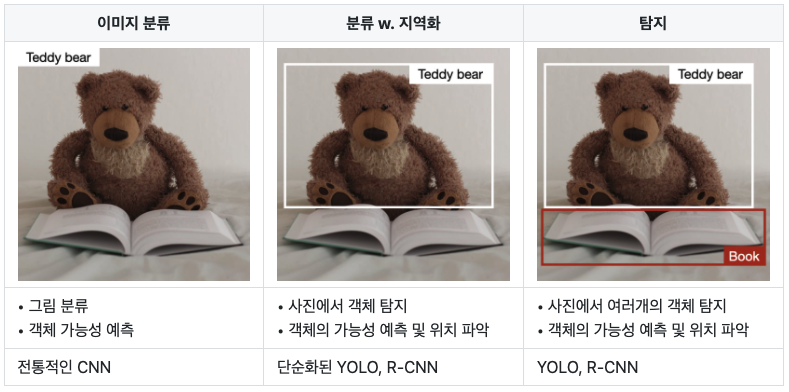

4. 발전

요약

- 합성곱(Convolutions)은 밀집층(Dense Layer)과 비슷하게 입력과 가중치를 곱하고 절편을 더하는 선형 계산이다.

- 하지만 밀집층과 달리 각 Convolutions는 입력 전체가 아니라 일부만 사용하여 선형 계산을 수행한다.

- Convolutions Layer의 Filter는 밀집층의 Neuron에 해당한다.

- Filter의 가중치와 절편을 종종 커널이라고 부른다.

- 자주 사용되는 커널의 크기는 (3,3) 또는 (5,5)이다.

- 커널의 깊이는 입력의 깊이와 같다.

- Feature Map은 합성곱 층이나 풀링 층의 출력 배열을 의미한다.

- 필터 하나가 하나의 특성 맵을 만든다.

- 합성곱 층에서 5개의 필터를 사용하면 5개의 Feature Map이 만들어 진다.

- Padding은 합성곱 층의 입력 주위에 추가한 0으로 채워진 픽셀이다.

- 패딩을 사용하지 않는 것을 Valid Padding이라고 하고 합성곱 층의 출력 크기를 입력과 동일하게 만들기 위한 것을 Same Padding이라고 한다.

- Stride는 합성곱 층에서 필터가 입력 위를 이동하는 크기이다.

- 풀링은 가중치가 없고 특성 맵의 가로 세로 크기를 줄이는 역할을 수행한다.

- 대표적으로 최대 풀링과 평균 풀링이 있으며 (2,2) 풀링으로 입력을 절반으로 줄인다.

- 출처 : https://stanford.edu/~shervine/l/ko/teaching/cs-230/cheatsheet-convolutional-neural-networks